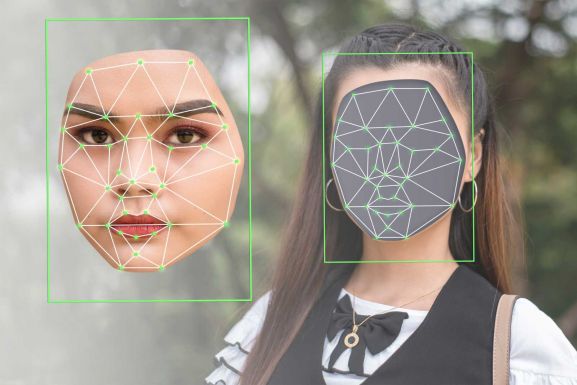

Valós veszély: egyre tökéletesebbek és olcsóbbak a mesterséges intelligencia alapú megoldások – ez megnehezíti a deepfake kiszűrését

Csak kapkodjuk a fejünket, amikor egyre több politikus, elismert szakember bizonygatja, hogy bár úgy tűnik, mégsem ő szerepel a közösségi médiában szélsebesen terjedő videón, nem ő ajánlja a betonbiztos befektetést, a jó pénzért megvásárolható csodakezelést. A mesterséges intelligencia egyre fejlettebb, egyre megfizethetőbb, a szabályozása viszont még gyerekcipőben jár, így várhatóan a visszaélések száma a következőkben tovább növekszik, figyelmeztet a Maszol által megszólaltatott szakértő.

Dr. Seer László marketingszakember, a Babeș-Bolyai Tudományegyetem (BBTE) Közgazdaság- és Gazdálkodástudományi Kar adjunktusa hangsúlyozta, két-három év múlva olyan szintre fejlődik a technológia, hogy szabad szemmel még a jelenlegi apró, árulkodó jelekből sem tudjuk kiszűrni, hogy hamisítvánnyal állunk szembe.

Megfelelő szabályozás hiányában most éljük a mesterséges intelligencia Vadnyugatát

Most éljük a mesterséges intelligencia vadnyugati-korszakát, egyre több lehetőséget kínál egyre olcsóbban, de a megfelelő szabályozás hiányában tisztességtelen célokra, átverésre, csalásra is egyre többször bevetik. Hasonló a helyzet, mint az aranyláz idején, amikor az Egyesült Államokban rengetegen elindultak aranyat ásni, és utólag derült ki, hogy sokan törvénytelenséget elkövetve használták ki a lehetőséget és a szabályozás hiányát, vont párhuzamot a szakértő.

Felidézte már tizenöt-húsz éve léteznek ezek a megoldások, de ahhoz, hogy a mesterséges intelligencia élethű, közvetlenül felhasználható eredményeket hozzon létre, óriási számítási kapacitásra volt szükség, ami hatalmas költséget jelentett. Az elmúlt pár évben viszont nemcsak a formái fejlődtek ugrásszerűen, hanem egyre olcsóbb. Egyszerű Google-kereséssel fél nap alatt megdöbbentően sok minden megvásárolható, amivel hamis videót lehet létrehozni, ki lehet cserélni az arcot a fotókon, vagy manipulálni lehet a hangot.

Tőlünk függ, hogy jóra vagy rosszra használjuk

A technológia előjele semleges: jó, ha jóra használjuk és rossz, ha rosszra, ez teljesen a felhasználóktól, az emberektől függ. Ugyanez volt a helyzet az elektromos árammal is, százhúsz évvel ezelőtt az újságok leközölték, hogy az áram ártalmas, ráz, ami ma nagyon viccesnek tűnik, hiszen már tudjuk, hogy az elektromosság nélkül nem jöhetett volna létre a civilizáció, amiben élünk, mutatott rá Seer László. Meglátása szerint, harminc-negyven év múlva, ha visszanézünk, azt látjuk majd, hogy a mesterséges intelligencia kapcsán elsősorban a megfelelő jogi szabályozás hibázott, jelenleg még nem tudjuk úgy korlátok közé szorítani, hogy a fejlődését ne akadályozzuk. A mesterséges intelligencia olyan program, amely különböző, az ember által szolgáltatott adatok alapján tanul, és bizonyos megoldásokat, az ember számára közvetlenül felhasználható módon tesz lehetővé, tehát a számítógép képes mentális műveletekre. Már ma is rengeteg területen – az egészségügyben, a gazdaságban, vagy akár az időjárás terén – hallatlanul hasznos, például különböző bonyolult folyamatok gyors és pontos előrejelzésére képes a meglevő adatok alapján. A szórakoztatóiparban a fotók, videók, hangok gyors és hatékony alakításával felgyorsítja, érdekessé, izgalmassá teszi a tartalomgyártást.

A mesterséges intelligencia olyan program, amely különböző, az ember által szolgáltatott adatok alapján tanul, és bizonyos megoldásokat, az ember számára közvetlenül felhasználható módon tesz lehetővé, tehát a számítógép képes mentális műveletekre. Már ma is rengeteg területen – az egészségügyben, a gazdaságban, vagy akár az időjárás terén – hallatlanul hasznos, például különböző bonyolult folyamatok gyors és pontos előrejelzésére képes a meglevő adatok alapján. A szórakoztatóiparban a fotók, videók, hangok gyors és hatékony alakításával felgyorsítja, érdekessé, izgalmassá teszi a tartalomgyártást.

Ez csak néhány terület, de nagyon sok más ágazatban teljesen felforgatja a munkavégzést, felgyorsítja, hatékonyabbá teszi, és vitathatatlan előnye, hogy végre rábízhatjuk azokat az emberi gondolkodást igénylő tevékenységeket, amit egyébként nem szívesen végzünk, részletezte Seer László. Másrészt befolyásolhatja a munkaerőpiac működését, ha bizonyos területeken túl hirtelen derül ki, hogy bizonyos munkakörökre már nincs szükség.

A társadalomnak és az egyénnek is árthat

A mesterséges intelligencia Achilles-ina a közösségi média, ott lehet a bevetésével a leginkább manipulálni az embereket, hívta fel a figyelmet a szakértő. Erre jó példa a napokban szélsebesen terjedő pénzügyi befektetési csalás, amikor hamis felhasználók osztják a manipulált, mesterséges intelligencia által létrehozott videókat, melyeken ismert közéleti szereplők, például a Román Nemzeti Bank elnöke, Mugur Isărescu mond valótlan állításokat.

De beavatkozhat a politikai kampányokba, hiszen az emberek nagy része a sajtóra, a közösségi médiára hagyatkozik, amikor véleményt formál. Ezen a téren a közösségi média a manipuláció melegágya, mert ott nincs olyan jellegű szűrés, mint egy szerkesztőségben, ahol még utána lehet nézni az adott információ forrásának.

Arra vagyunk kódolva, hogy ez első információt elhiggyük és gyorsan döntsünk

Az idegrendszerünk sok tízezer évvel ezelőtt alakult ki, a génjeinkben kódolt, ahogy a valóságot felfogjuk, a mentális torzítás oda vezet, hogy gyors információk alapján, gyors döntéseket hozunk, mert ez hatékonyabb, mintha sokat töprengünk. Másrészt a lehorgonyzási heurisztika jelensége miatt hajlamosabbak vagyunk az elsőre látott információnak nagyobb hitelt adni.

A deepfake éppen ezért lehet olyan sikeres, mert ahogy a szemünk elé kerül egy tartalom, azonnal hitelt adunk neki, és már rá is kattintunk. Belépünk a közösségi oldalra, görgetünk, és egységnyi idő alatt esélyünk sincs, hogy kiszűrjük a csalást. Másrészt ezek a tartalmak ugyanazokat a megtévesztési technikákat alkalmazzák, melyek a valóságban is jól működnek, amikor például egy bűvész bemutat egy trükköt, és tulajdonképpen a figyelmünkkel játszik. A megtévesztés a szemünk előtt történik, és mégsem vesszük észre, mert az agyunk azt jelzi, érdekes, esetleg hasznos, és utólag már nehéz visszatáncolni, részletezte Seer László.

A technológia egyre jobb lesz, a csalás kiszűrése egyre nehezebb

Aki figyelmesen nézi a Mugur Isărescu videót, főleg ha tudja is, hogy az hamis, kiszűrheti az árulkodó apró jeleket: homályosabb a kép, ahol a szája mozog, ugrások vannak a felvételben. Viszont a technológia egyre tökéletesedik, és egyre kevésbé hibázik, két-három év múlva már biológiai adottságaink segítségével képtelenek leszünk kiszűrni az apró jeleket, akkor más megoldás kell nézni, mutatott rá a szakértő.

A deepfake technológiáról hallva legtöbbször a mozgóképek világára, a videókra gondolunk, de a hangalapú csalásokra is figyelni kell. A telefonhívások kiváló minőségű hangátvitelt biztosítanak, nem recseg-ropog a vonal, megszoktuk, hogy felismerjük a hívó hangját. Azonban ha megszereznek egy adott hosszúságú hangmintát a mesterséges intelligencia alapú megoldással bármilyen szöveg bármilyen érzelmi töltettel felmondatható. Ez nagyon erős hatású, ha a rokonunk, gyermekünk hangját halljuk a telefonban, hogy segítséget kér, mert bajban van, nehéz józanul kiszűrni a csalást.

Seer László szerint, át kell gondolni az internet működését, például azt, hogy bármilyen digitális tartalom visszakövethető legyen a blokklánc technológia segítségével. „Ez megoldható, bár több ország összefogására, szabályozására lesz szükség, de már vannak területek, ahol megfelelő jogi megoldásokat találtak, például a torrent-fájlcsere. Ez egy folyamatos harc lesz, soha nem lesz tökéletes védelem” – vetítette előre az egyetemi előadó.”

A kézenfekvő megoldás: mielőtt bármit elhiszünk, lépjünk hátra és számoljunk el tízig

A valóságban is rengeteg ember esik áldozatul a csalásnak: becsengetnek idős emberekhez, rátukmálnak sok pénzért egy bóvlit, tarolnak a telefonos csalások. Az interneten még kevésbé vagyunk biztonságban, különösen úgy, hogy a technológiák egyre sikeresebbek. Seer László szerint már az iskolában tanítani kellene a kritikai gondolkodást, társadalmi kampányokat indítani, felhívni a figyelmet, hogy bármilyen lehetőséggel találkozunk, először lépjünk hátra, számoljunk el tízig, és vizsgáljuk meg még egyszer. Amikor a telefont kézbe vesszük, ne feledkezzünk meg arról, hogy nem minden az, aminek látszik.

Már ezzel az egyszerű lépéssel tizedére lehet csökkenteni az átveréseket. Nem feltétlenül kell minden lehetőséget elutasítani, még akkor sem ha túl szépnek tűnik ahhoz, hogy igaz legyen, hiszen a világunk exponenciálisan fejlődik, soha nem élt az emberiség ilyen korban, meghökkentő dolgok is bizonyulhatnak igaznak. Viszont ha egyszerű, amatőr- újságírói technikával felkutatjuk az információ forrását, rákeresünk a Google-en, megnézzük, mások mit mondanak róla, lecsökkentjük annak a lehetőségét, hogy csalás áldozatává váljunk.

Jelenteni mindenképpen kell – de végső megoldás nem létezik

Versenyfutás zajlik a bűnözőkkel, a védekező eszközeink egy része elavult, ennek ellenére minden csalást, hamisítvány érdemes jelenteni, nemcsak a közösségi oldalaknak, hanem a rendőrségnek is. Persze, ha egy automatizált megoldással egyszerre tízezer felhasználónak ellopják a Facebook profilját és azokon keresztül hamis videókat osztanak meg, ha mindannyian feljelentést tesznek, a rendőrségnek nincs olyan kapacitása, hogy normális időkereten belül ezt megoldja. Másrészt a deepfake egyre inkább terjed, egy-két ember elindítja, már önálló utat jár, de a visszajelzés miatt is érdemes jelenteni.

Már áprilisban hatályba léphet a deepfake tartalmakra vonatkozó törvénytervezet, melyet a parlament tárgyal, és amely alapján a mesterséges intelligencia segítségével előállított hamis hanganyagokért vagy videótartalmakért akár két év szabadságvesztést is kiszabhatnak. Ez első lépésnek jó, visszafoghatja a problémát, értékelt Seer László.

„Megszabadulni nem fogunk a deepfake-től, mint ahogy a fizikai térben, a mindennapokban sem tudtuk megszüntetni a csalásokat, de sokat lehet tenni a visszaszorítása érdekében” – összegzett a szakértő.

A most újraolvasásra ajánlott cikkünket korábban 2024. február 17-én olvashatták a Maszolon.

CSAK SAJÁT

.jpg)

.jpg)

.jpg)

.jpg)

.jpg)